Table of Contents

La Inteligencia Artificial fue la gran protagonista de la apertura de CES 2026, y AMD decidió poner las cartas sobre la mesa desde el primer minuto.

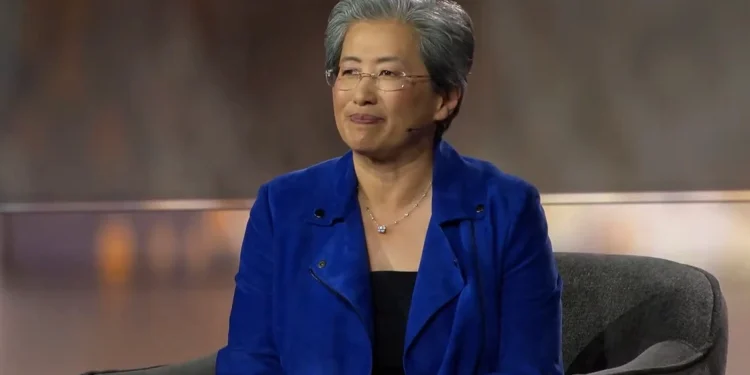

En el escenario, la doctora Lisa Su, Presidenta y CEO de la compañía, lo resumió con una frase tan provocadora como honesta: “No han visto nada todavía”.

Y no es marketing vacío. Es una declaración sobre hacia dónde va la industria, cuánta computación va a necesitar y por qué lo que viene será, literalmente, otra escala de todo.

Para AMD, la Inteligencia Artificial no es una moda: La Inteligencia Artificial es la tecnología más importante de los últimos 50 años, y es absolutamente nuestra prioridad número uno, afirmó Lisa Su ante un auditorio lleno en Las Vegas y millones de personas conectadas en línea.

Hoy, explicó, la tecnología de AMD ya toca la vida de miles de millones de personas: desde centros de datos y supercomputadores hasta redes 5G, transporte y videojuegos.

De millones a miles de millones: la explosión de la IA

Uno de los datos más contundentes de la noche fue la velocidad de adopción. Según Lisa Su, pasamos de “un millón de personas usando IA” a más de mil millones de usuarios activos, y la proyección es todavía más ambiciosa: más de 5.000 millones de usuarios a medida que la IA se vuelva tan cotidiana como el smartphone o Internet.

Pero hay un problema: la computación. La base de todo esto. En solo tres años, la capacidad global pasó de 1 zetaflop en 2022 a más de 100 zetaflops en 2025. Y aun así, no alcanza.

No tenemos casi suficiente computación para todo lo que podemos hacer, dijo Lisa Su. La meta es brutal: multiplicar por 100 esa capacidad y superar los 10 zetaflops en los próximos cinco años.

Para ponerlo en contexto, un zetaflop es un 1 seguido de 24 ceros. O, como lo explicó en escena: 10 zetaflops es 10.000 veces más computación de la que teníamos en 2022. Nunca ha habido algo así en la historia de la computación.

Helios y MI-455: el corazón del nuevo músculo de IA

En ese camino aparece Helios, la nueva plataforma de racks de AMD para la “era Yotta”. Un monstruo de ingeniería -literalmente pesa casi 7.000 libras- diseñado para entrenar y ejecutar los modelos de IA más grandes del planeta. En su interior viven los nuevos GPUs Instinct MI-455, construidos en procesos de 2 y 3 nanómetros, con memoria HBM4 y un diseño 3D avanzado.

Lisa Su lo dijo sin rodeos: MI-455 es el chip más avanzado que hemos construido. Tiene 320.000 millones de transistores y, según AMD, permitirá hasta 10 veces más performance en un amplio rango de modelos frente a la generación anterior. El mensaje es claro: más modelos, más grandes, más agentes, más capaces.

OpenAI: cuando la IA deja de ser un chat y se vuelve un asistente real

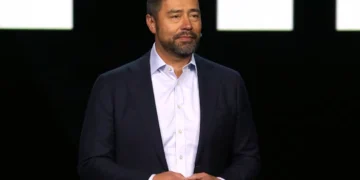

En el escenario también estuvo Greg Brockman, presidente y cofundador de OpenAI. Recordó que ChatGPT fue el primer producto que realmente llevó esta tecnología a la vida diaria de millones de personas. La primera vez que tuvimos algo tan útil que muchas personas querían usar fue ChatGPT, explicó.

Pero el punto clave vino después: ya no hablamos solo de preguntar y responder. Nos estamos moviendo a un mundo de funciones agénticas, donde no trabajas con un agente, sino con una flota de agentes que hacen tareas por ti durante horas o días. Y eso, obviamente, va a requerir mucho más computación de la que tenemos ahora.

Brockman compartió dos historias reales en salud donde ChatGPT ayudó a detectar situaciones médicas graves que habían pasado desapercibidas. Para él, ese es el verdadero valor: Estamos viendo beneficios reales en la vida de la gente.

Luma AI y la creación de mundos: video, 4K, agentes creativos

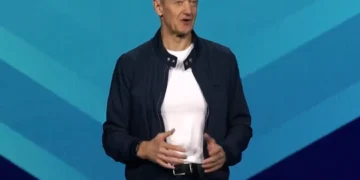

Otra de las demostraciones más impactantes vino de Luma AI. Su CEO, Amit Jain, explicó que su misión es construir inteligencia multimodal capaz de entender y simular el mundo. Su nuevo modelo Ray-3 es capaz de generar video en 4K y HDR, pero lo más interesante es la idea de “editar el mundo” con IA.

Amit fue directo sobre por qué eligieron AMD: Hoy, 60 % de nuestros workloads de inferencia están corriendo en AMD, y añadió que la economía de la inferencia es crítica cuando un video de 10 segundos puede equivaler a 100.000 tokens.

PCs con IA: la inteligencia se vuelve personal

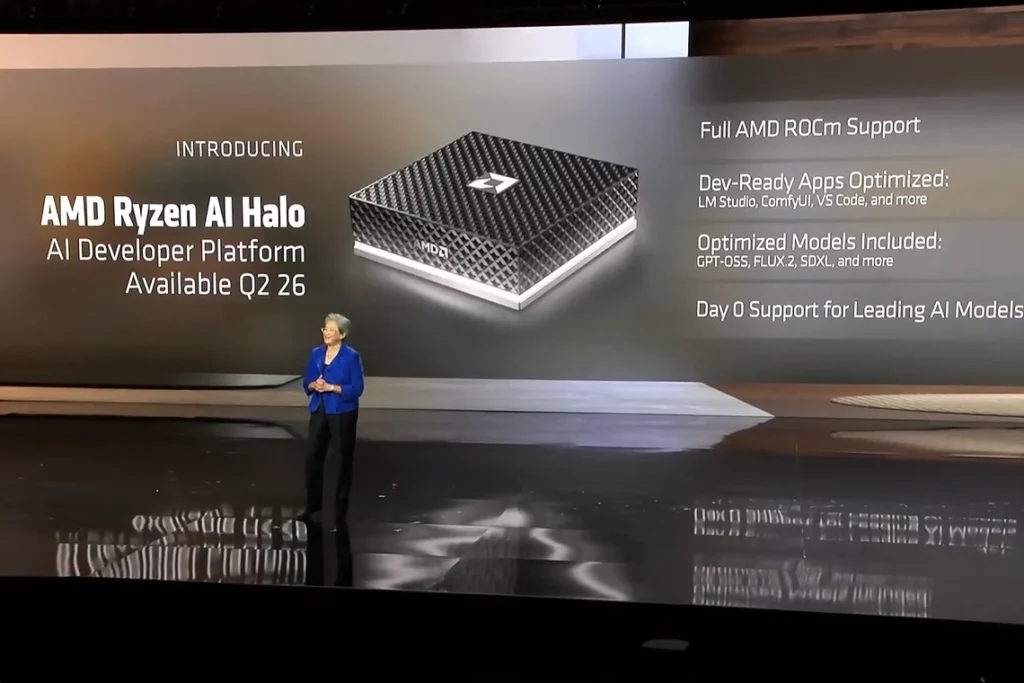

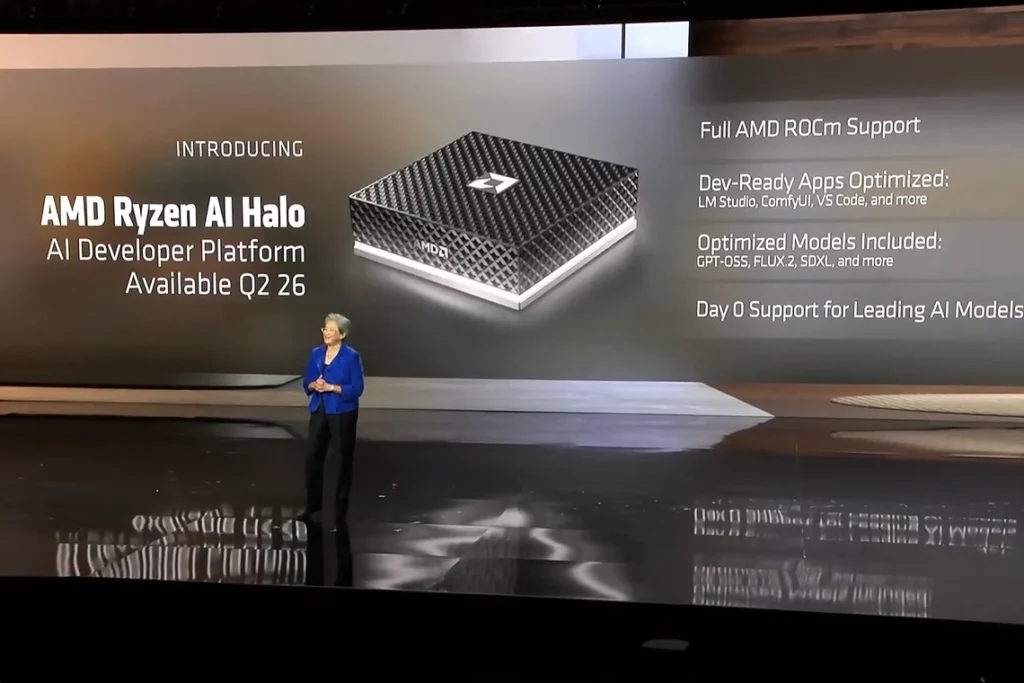

No todo es nube y centros de datos. Lisa Su dejó claro que el PC entra en una nueva etapa: deja de ser una herramienta y se vuelve un partner activo. Con los nuevos Ryzen AI 400, AMD promete llevar creación de contenido, productividad y asistentes inteligentes directamente al dispositivo, incluso sin conexión.

De hecho, mostraron un mini sistema capaz de ejecutar modelos de hasta 200.000 millones de parámetros de forma local. En palabras simples: la IA pesada ya no vive solo en el cloud.

Salud, ciencia y descubrimiento de medicamentos

El cierre más humano llegó con los casos de uso en salud. Desde AppSci, Illumina y AstraZeneca, el mensaje fue unánime: la IA está cambiando cómo se descubren medicamentos, cómo se analiza el genoma y cómo se personalizan tratamientos.

Shawn McClain, CEO de AppSci, lo resumió así: Ahora podemos escribir más de un millón de medicamentos en un solo día gracias a la combinación de biología generativa e infraestructura de cómputo.

Jacob Thaysen, CEO de Illumina, recordó que el genoma humano es como un libro de 200.000 páginas y que sin esta capacidad de cómputo sería imposible leerlo y entenderlo a escala. Y desde AstraZeneca dejaron claro que la IA no es solo productividad, es una nueva forma de innovar de principio a fin.

Aún hay mucho por hacer: AMD

CES 2026 dejó algo muy claro: la Inteligencia Artificial ya no es un experimento. Es infraestructura crítica, es economía, es salud, es creatividad y es ventaja competitiva para países y empresas.

Pero, como dijo Lisa Su al inicio, apenas estamos empezando. El verdadero cuello de botella será cuánta computación podamos construir… y qué tan bien sepamos usarla.